You are here:

AI accelerator (NPU) IP - 32 to 128 TOPS

Origin™ E8 专为以性能为主要设计目标的应用而设计,包括汽车/ADAS 和数据中心应用。艾伯德的高级内存管理可确保持续的 DRAM 带宽和理想的总体系统性能。Origin E8 深度学习加速器 (DLA) 具有 32 至 128 TOPS 性能,实际利用率高达 90%(在运行 ResNet 等常见工作负载的片上测量),在图像相关的任务中表现出色,如计算机视觉、图像分类和目标检测。Origin E8 提供多任务支持,能够更好地利用硬件资源并降低系统成本。该加速器具备高效神经网络引擎,使设计人员可以开发采用被动散热的产品,从而进一步降低系统成本。

查看 AI accelerator (NPU) IP - 32 to 128 TOPS 详细介绍:

- 查看 AI accelerator (NPU) IP - 32 to 128 TOPS 完整数据手册

- 联系 AI accelerator (NPU) IP - 32 to 128 TOPS 供应商

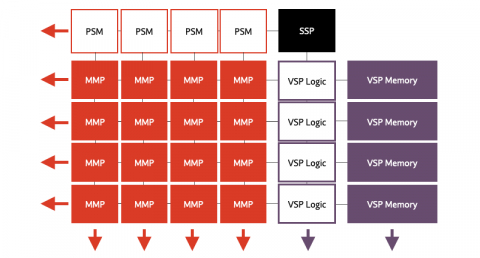

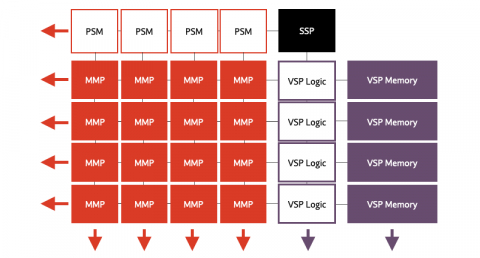

Block Diagram of the AI accelerator (NPU) IP - 32 to 128 TOPS

AI accelerator IP

- AI accelerator (NPU) IP - 16 to 32 TOPS

- AI accelerator (NPU) IP - 1 to 20 TOPS

- Deeply Embedded AI Accelerator for Microcontrollers and End-Point IoT Devices

- Performance Efficiency Leading AI Accelerator for Mobile and Edge Devices

- High-Performance Edge AI Accelerator

- Ultra-low-power AI/ML processor and accelerator