2-stage Power Amplifier 14.5GHz ultra-efficient Dual-Drive™ PA

AI accelerator (NPU) IP - 16 to 32 TOPS

查看 AI accelerator (NPU) IP - 16 to 32 TOPS 详细介绍:

- 查看 AI accelerator (NPU) IP - 16 to 32 TOPS 完整数据手册

- 联系 AI accelerator (NPU) IP - 16 to 32 TOPS 供应商

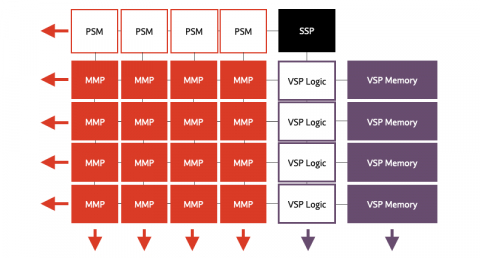

Block Diagram of the AI accelerator (NPU) IP - 16 to 32 TOPS

AI accelerator IP

- AI accelerator (NPU) IP - 1 to 20 TOPS

- AI accelerator (NPU) IP - 32 to 128 TOPS

- Deeply Embedded AI Accelerator for Microcontrollers and End-Point IoT Devices

- Performance Efficiency Leading AI Accelerator for Mobile and Edge Devices

- High-Performance Edge AI Accelerator

- Ultra-low-power AI/ML processor and accelerator